如何避免滥用短剧用户AI创作伦理:全面探讨与防范措施

随着人工智能(AI)技术的不断发展,短剧创作逐渐融入了这一领域。AI不仅能协助编剧、导演和演员在创作过程中提供灵感,还能提高生产效率,推动内容创作的创新。然而,随着AI技术的普及,滥用的风险也随之而来。短剧用户AI创作伦理成为亟待关注的问题。本文将深入探讨如何避免在短剧创作中滥用AI,确保其在符合伦理的框架内运作,保障创作的公平性、透明性和合规性。

一、短剧AI创作的潜力与挑战

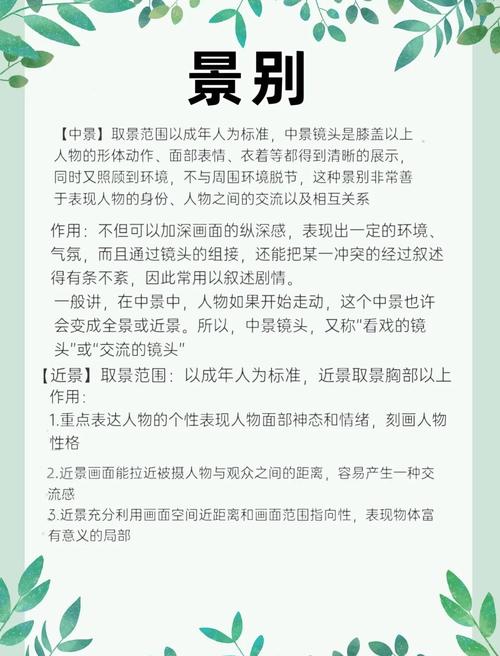

短剧作为一种轻量化、短时长的视频内容形式,越来越受到观众的喜爱。AI在短剧创作中的应用,主要体现在脚本生成、角色设计、情节构建等方面。AI可以通过大数据分析观众的喜好和情感需求,自动生成符合市场趋势的剧本,甚至可以通过深度学习为剧本创作提供更富创意的内容。

然而,AI的滥用同样带来了挑战。首先,AI创作可能导致内容的同质化,过度依赖算法生成的内容会使短剧缺乏创作者的个性化风格。其次,AI生成的内容可能出现伦理问题,例如误导性信息、歧视性言论等。这些问题不仅影响内容的质量,还可能引发公众的不满,甚至造成法律责任。因此,如何合理运用AI技术,避免其滥用,是亟待解决的问题。

二、AI创作伦理的核心要素

要确保短剧创作中的AI技术不会被滥用,必须明确其伦理框架。AI创作伦理的核心要素包括以下几点:

1. 透明性与可追溯性

在短剧创作过程中,AI的使用应当公开透明,观众应能够明确知晓哪些部分是由AI生成的,哪些部分是由人工创作的。这不仅有助于提升观众的信任感,也有助于追溯内容创作的源头,防止不当内容的产生。

2. 公正性与多元性

AI创作应避免固守单一的价值观和创作风格,尤其要避免性别、种族、宗教等方面的偏见。AI系统应该根据多元化的创作需求进行训练,并且始终确保创作内容的公平性与包容性,尊重不同文化和社会群体的权益。

3. 隐私保护

AI技术在创作过程中需要处理大量的数据,尤其是观众行为数据和情感数据。如何合理使用这些数据,避免泄露个人隐私,是AI创作伦理的重要组成部分。所有数据的收集与使用应当遵循隐私保护法律法规,确保用户信息的安全。

4. 责任归属

在AI创作过程中,如果出现内容侵权或不当信息,应该明确责任的归属。虽然AI能够生成内容,但创作者(无论是公司还是个人)应对AI生成内容承担最终责任,确保内容符合法律法规和伦理标准。

三、如何避免滥用AI技术进行短剧创作

为了避免滥用AI技术,创作者和平台可以采取以下措施:

1. 严格的内容审核机制

短剧平台应建立严格的内容审核机制,对AI生成的内容进行多层次的审核。审核人员可以检查剧本内容是否存在不当言论,是否符合社会伦理规范,并对AI生成内容进行人工修正,确保创作的质量和合法性。

2. AI与人工创作的平衡

在创作短剧时,AI应作为辅助工具,而不是完全取代人工创作。创作者应保持创作的主动性,利用AI技术提供灵感和支持,但最终的创作决策仍应由人类编剧和导演做出。这样可以避免AI创作过度同质化和创意匮乏的问题。

3. 设立伦理审查委员会

对于AI创作的伦理问题,可以设立专门的伦理审查委员会,邀请专家、学者以及社会各界代表共同参与讨论,确保AI创作的过程符合社会道德标准。这种审查机制能够有效避免AI创作中的潜在风险,确保内容的多元性和公正性。

4. 加强创作者的AI使用培训

创作者在使用AI工具时,应接受必要的培训,了解AI技术的工作原理和可能带来的伦理风险。通过提高创作者的技术素养和伦理意识,可以减少不当使用AI技术的情况发生。

5. 法律法规的制定与遵循

政府和行业协会应积极推动相关法律法规的制定,明确AI在创作过程中的法律责任与伦理规范。平台和创作者在创作短剧时,应严格遵循这些法律法规,确保创作的合法性与合规性。

四、结语

AI技术的快速发展,为短剧创作带来了巨大的机遇,但也伴随着滥用的风险。为了确保AI创作的伦理性,避免其在短剧创作中造成不良影响,创作者、平台以及相关部门需要共同努力,建立透明、公正、合规的创作机制。只有在遵循伦理的基础上,AI才能真正成为短剧创作的有益工具,推动内容创作的多元化和创新性发展。