短剧用户AI营销伦理:如何避免滥用?

在数字化时代,短剧作为一种创新的娱乐形式,已经成为了许多人日常生活的一部分。与此同时,随着人工智能技术的快速发展,短剧与AI营销的结合也成为了一种热门趋势。然而,这种结合带来的不仅是便利与创新,还有一系列伦理问题,尤其是滥用AI进行用户营销的风险。本文将详细探讨短剧用户AI营销的伦理问题,并提供如何避免滥用的建议。

短剧与AI营销的结合

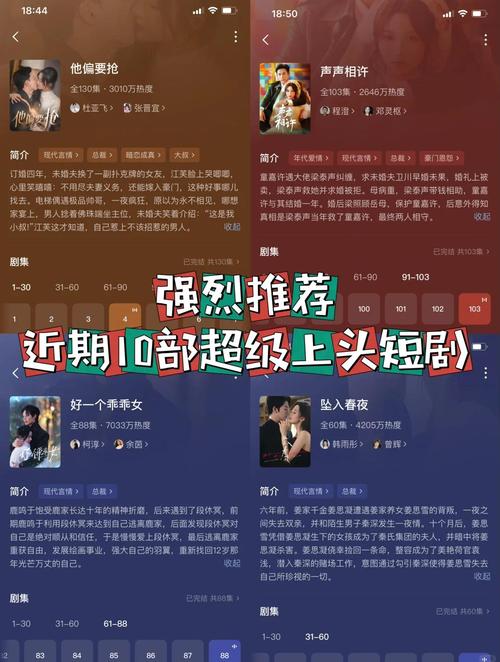

短剧是一种具有短小精悍特点的故事形式,通常通过视频平台进行传播,吸引了大量年轻观众。随着AI技术的进步,越来越多的短剧内容开始使用AI进行定制化创作、用户分析和营销推广。AI可以根据用户的观看历史、兴趣爱好和行为数据,精准推送个性化的广告和内容,从而提高转化率和用户参与度。

然而,AI在短剧营销中的应用,虽然提升了营销效率和精准度,但也引发了一系列伦理问题。如何在充分利用AI优势的同时,避免过度干扰用户、侵犯隐私,甚至引发社会道德危机,是亟待解决的关键问题。

滥用AI营销的潜在风险

1. 侵犯用户隐私

AI在短剧营销中最重要的功能之一是收集和分析用户数据。通过分析用户的观看行为、搜索记录和社交互动,AI能够建立用户的兴趣模型,进而推送精准的广告或内容。然而,这种行为往往会引发隐私泄露的风险,尤其是当用户并未明确同意或了解数据被如何使用时。

2. 过度商业化和内容操控

AI在营销中用于内容推送时,可能会过度倾向于商业化,导致短剧创作被过度商业化,内容失去原本的艺术性和多样性。AI根据用户的喜好推送广告和内容,可能让观众陷入一个信息茧房,逐渐失去对多元化内容的接触和判断能力,从而影响他们的选择和思维。

3. 情感操控

AI在短剧中的应用,不仅仅局限于内容创作,还包括对用户情感的操控。通过精确分析用户的情感波动,AI可以在适当的时候推送符合用户情感状态的内容或广告,从而提高用户的参与度和消费欲望。然而,这种情感操控可能会对用户产生负面的心理影响,尤其是在年轻用户中,可能导致他们对虚拟世界的过度依赖。

如何避免滥用AI营销?

1. 增强透明度和用户同意

为了避免侵犯用户隐私,AI营销平台应当加强透明度,让用户明确知晓其数据如何被收集和使用。平台应该在用户注册或使用时,提供详细的隐私政策,并且获得用户明确的同意。此外,用户应当拥有查看、修改和删除自己数据的权利,确保他们的个人信息得到充分的保护。

2. 保持内容创作的多样性和独立性

AI虽然能够通过分析用户喜好提供定制化的内容,但短剧创作者应保持内容创作的多样性和独立性。避免AI过度主导内容的方向,让创作者能够自由表达,并确保观众接触到丰富的、非商业化的内容,保持创作的艺术性和独立性。

3. 建立情感操控的道德底线

虽然AI可以根据用户的情感状态推送适当的内容,但短剧营销平台应当设定情感操控的道德底线,避免过度引导或干扰用户的情感。营销人员和内容创作者应当有意识地避免利用用户的脆弱情绪进行过度营销,以保护用户的心理健康。

4. 建立行业规范和监管机制

为了防止AI营销的滥用,行业应当制定一系列伦理规范和监管机制。例如,设立专门的伦理委员会,审查AI营销平台和短剧创作中的内容,确保其符合伦理标准。同时,政府和行业组织应当加强对AI技术的监管,确保AI在短剧营销中的应用不违反社会道德和法律规定。

5. 用户教育和自我保护意识

除了平台和行业的责任,用户自身也应当具备一定的自我保护意识。用户应当学会如何识别广告和内容中的营销成分,并在使用过程中保护好自己的隐私信息。平台可以通过用户教育,提醒用户在享受个性化推荐的同时,也要保持对隐私和内容真实性的警觉。

结论

短剧与AI营销的结合无疑带来了许多便利和创新,但也不可忽视其带来的伦理问题。为了避免滥用,确保AI营销能够在符合伦理的框架内运行,平台、创作者、监管机构和用户都应承担起相应的责任。通过提高透明度、保持创作的多样性、设立道德底线以及加强行业监管,我们能够在享受短剧与AI营销带来的便利的同时,避免其潜在的负面影响,推动AI营销的健康发展。